机器学习笔记

机器学习笔记

决策树

决策树的划分选择

信息增益

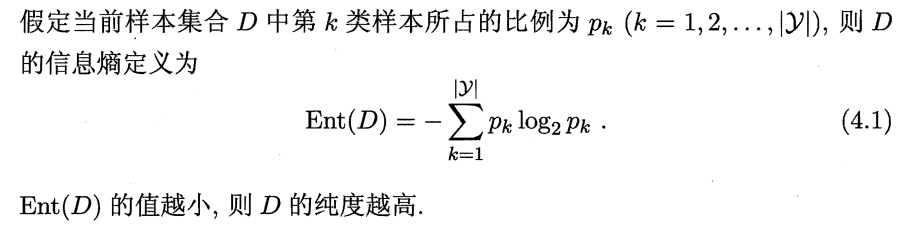

”信息熵“(information entropy)是度量样本集合纯度最常用的一种指标

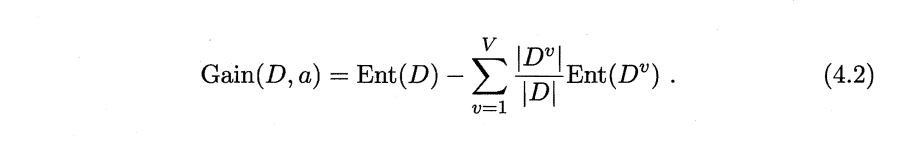

”信息增益“(information gain)

ID3算法采用”信息增益“

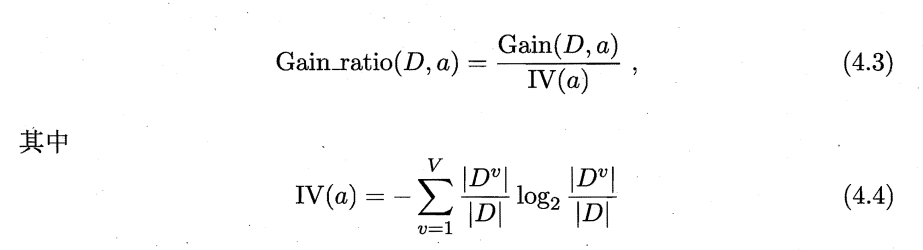

”增益率“(gain ratio)

C4.5算法采用”增益率“

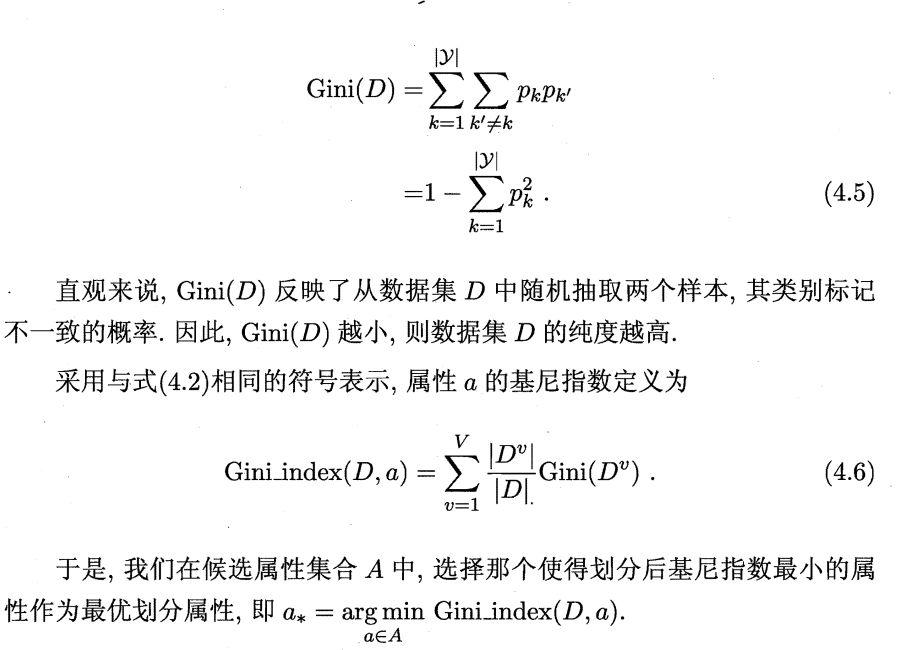

“基尼指数”(Gini index)

CART采用基尼指数

决策树的剪枝处理

剪枝(pruning)是决策树学习算法对付”过拟合“的主要手段。剪枝的基本策略有”预剪枝“(prepruning)和”后剪枝“(post-pruning)

- 预剪枝是指在决策树生成过程中,对每个结点在划分前先进行估计,若当前节点的划分不能带来决策树泛化性能的提升,则停止划分并将当前结点标记为叶结点

- 后剪枝则是先从训练集生成一颗完整的决策树,然后自底向上地对非叶结点进行考察,若将该结点对应的子树替换为叶结点能带来决策树泛化性能提升,则将该子树替换为叶结点

神经网络

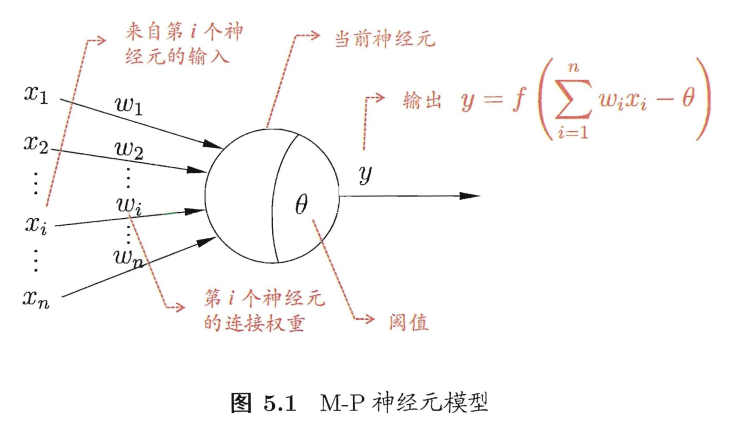

神经元模型

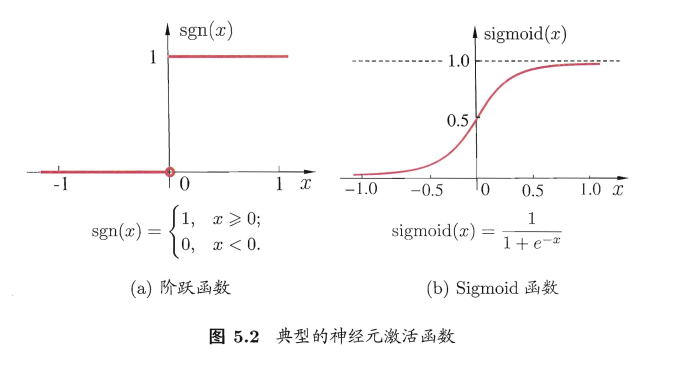

常用的神经元激活函数

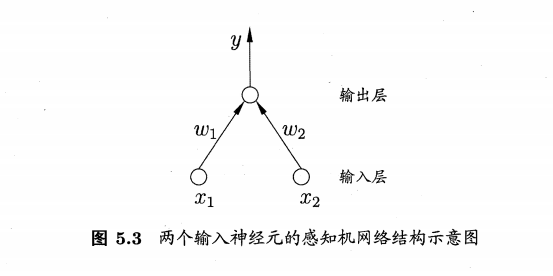

感知机与多层网络

感知机(Perceptron)由两层神经元组成,输入层接受外界输入信号后传递给输出层,输出层是M-P神经元,也称”阈值逻辑单元“(threshold logic unit)

感知机可以容易的实现逻辑与、或、非运算

误差逆传播算法

多层网络的学习能力比单层感知机强得多,欲训练多层网络,需要更强大的算法,误差逆传播算法(error BackPropagation,简称BP)就是其中最杰出的代表